在当今这个数据驱动一切、万物互联的时代,云数据中心早已超越传统物理机房的范畴,成为支撑数字经济运转的核心心脏。其运维的复杂度、重要性与创新需求,正以前所未有的速度演进。优云软件的资深专家叶帅对此有着深刻的洞察,他指出,互联网时代的云数据中心运维,特别是数据服务层面,正经历着一场深刻的思辨与变革。

一、从“资源托管”到“价值服务”的范式转移

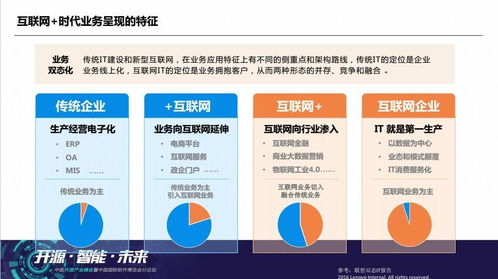

传统数据中心运维的核心在于保障物理或虚拟资源的稳定性、可用性与安全性,其思维是“看护”与“响应”。在互联网业务场景下,数据本身已成为核心生产要素。叶帅认为,现代云数据中心的运维焦点必须从“保障资源不中断”升维至“保障数据价值持续流动与兑现”。这意味着运维体系需要深度理解上层业务的数据消费模式、数据处理链路以及数据价值生成逻辑。运维团队不仅要确保数据库服务在线,更要关注数据加工的效率、数据API调用的性能、数据交付的实时性与一致性,从而直接支撑业务的敏捷创新与精准决策。

二、规模、弹性与复杂性带来的运维挑战

互联网业务天生具有海量、高并发、快速迭代的特性。这导致其背后的云数据中心呈现出极致的规模(万台乃至百万台服务器)、极致的弹性(分钟级扩缩容)以及极致的复杂性(微服务、多租户、混合云架构)。叶帅指出,在此环境下,传统依赖人工经验、脚本化和烟囱式工具的运维模式已完全无法应对。一次微小的配置变更或版本发布,都可能通过复杂的服务依赖链引发级联故障。因此,运维思辨必须转向以“数据驱动”和“智能自治”为核心。通过采集全栈、全链路的运维数据(指标、日志、追踪),构建统一的可观测性平台,并利用大数据分析与机器学习能力,实现问题的精准定位、风险的提前预测乃至故障的自愈。

三、数据服务运维的“生命全周期”管理

聚焦到“互联网数据服务”这一具体领域,叶帅强调,运维的边界已贯穿数据的“生老病死”全周期。这包括:

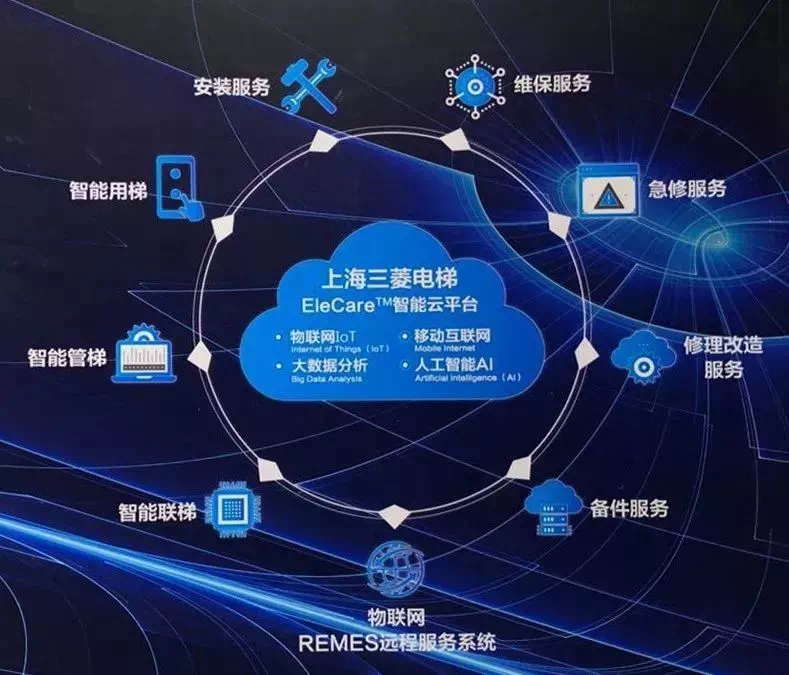

- 数据接入与集成运维:保障来自各业务线、IoT设备、外部合作伙伴的数据能够稳定、安全、低延迟地汇入数据中心。

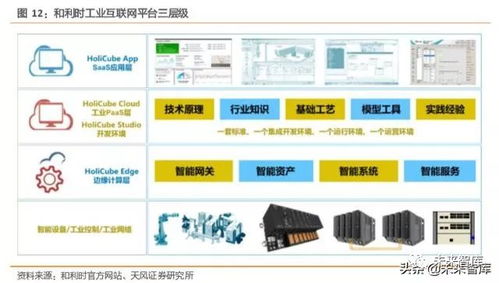

- 数据存储与计算运维:管理好庞大的数据湖、数据仓库及实时计算引擎(如Flink、Spark),在成本与性能间取得最佳平衡,确保计算任务高效完成。

- 数据治理与质量运维:确保数据的准确性、一致性、时效性与安全性,建立数据血缘追踪,自动化检测数据质量波动,这是数据可信度的基石。

- 数据服务与API运维:将数据资产以API、数据产品等形式对外提供服务,这要求运维保障服务的高可用、低延迟、高并发和精细化的权限与流量管理。

四、安全、合规与成本:不可逾越的基线

在享受数据价值的互联网数据服务运维必须筑牢安全与合规的防线。数据泄露、隐私违规的代价是巨大的。叶帅认为,运维需要将安全策略(如加密、脱敏、访问控制)内嵌到每一个数据处理环节,实现“安全左移”。随着数据量的爆炸式增长,成本控制成为核心考量。智能化的资源调度、冷热数据分层存储、无效数据自动清理等“FinOps”实践,成为衡量运维成熟度的重要标尺。

(上篇小结)

叶帅的观点清晰地揭示,互联网时代的云数据中心运维,尤其是数据服务运维,已从传统的后台支撑角色,转变为驱动业务效率与创新的关键引擎。其思维模式需要从被动响应转向主动赋能,从关注硬件稳定性转向关注数据价值链的健康度。这要求运维组织、工具平台与人员技能进行全方位的重构。在下篇中,我们将继续探讨叶帅关于应对这些挑战的具体技术路径、最佳实践以及未来运维形态的前瞻思考。